Scorriamo il feed e vediamo contenuti a conferma delle nostre idee. È la nostra bolla sociale. Un modello matematico spiega questo fenomeno. Ce ne parla Marco Menale per La Lente Matematica.

“Ecco, è proprio come dico io!” è la frase che passa per la testa scorrendo i contenuti dei nostri social. Ancora una volta abbiamo trovato qualcosa a supporto delle nostre opinioni. Anzi, siamo circondati da persone che la pensano come noi o confermano il nostro pensiero. E non accade su di un solo argomento. Dalla politica allo sport, passando pure per la cucina, è proprio un trionfo. Eppure, le cose non stanno proprio così. Gli algoritmi sanno come sfruttare un fenomeno psicologico noto, il confirmation bias, per bloccarci in una bolla sociale.

Il confirmation bias (bias della conferma in italiano) è la tendenza delle persone ad affidarsi e guardare solo informazioni che confermano le loro idee. È stato introdotto nel 1993 dallo psicologo cognitivo inglese Peter Cathcart Wason nel libro “The psychology of judgment and decision making”. Siamo qui interessati a una sua descrizione matematica. Per questo ci rifacciamo all’articolo “Modeling Confirmation Bias and Peer Pressure in Opinion Dynamics” di L. Liu, X. Wang, X. Chen, S. Tang e Z. Zheng.

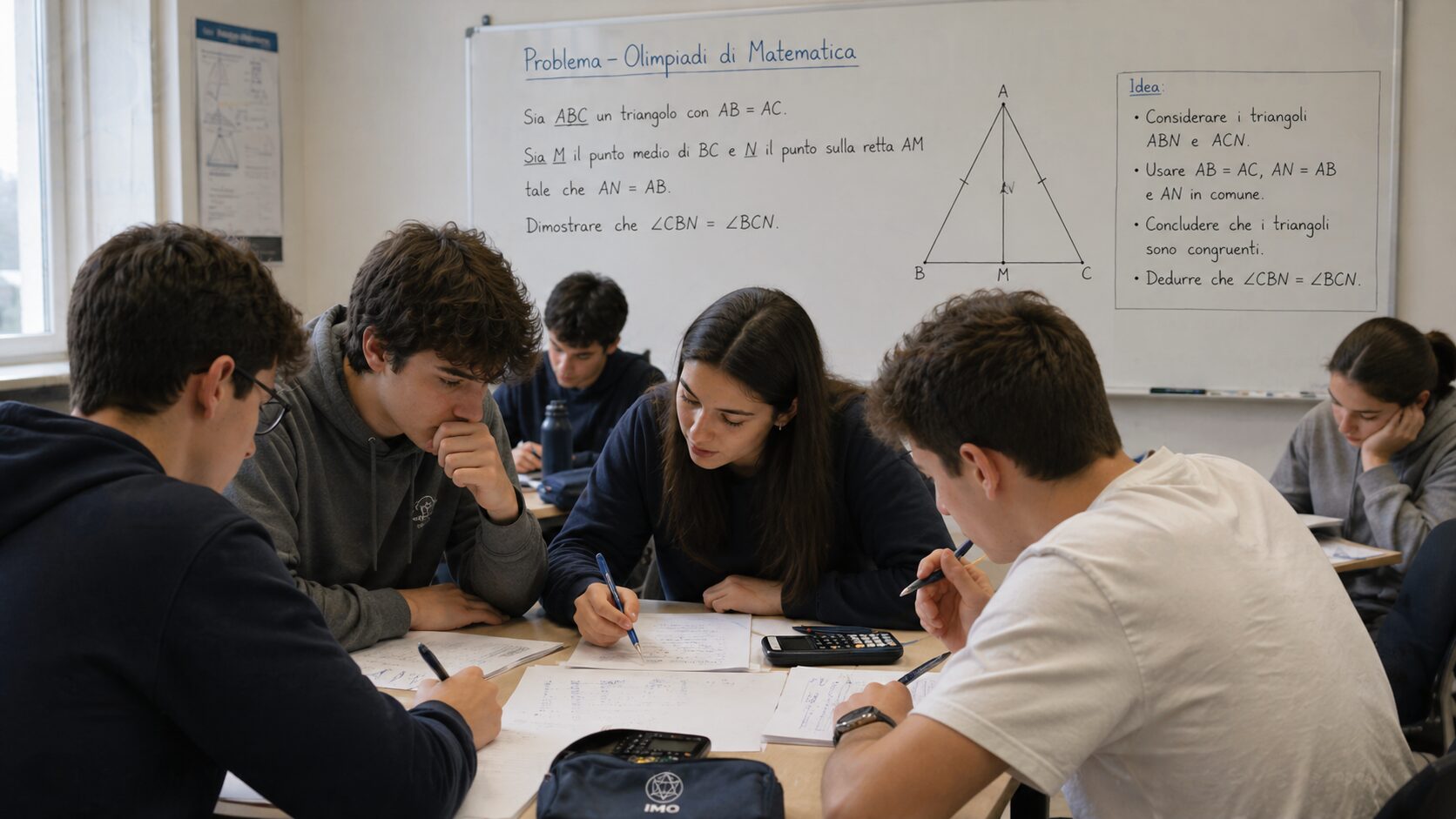

I ricercatori scrivono un modello di evoluzione di opinione su di una rete costituita da molti individui collegati su di un grafo. Ciascun individuo \(i\) ha opinione \(x_i \in [0,\,1]\) su di un certo argomento. Due valori vicini indicano idee simili, mentre valori lontani rappresentano posizioni differenti. La novità è l’introduzione di un valore soglia \(\delta\), detto identity scope, che traduce matematicamente la tendenza degli individui a considerare più credibili coloro che hanno opinioni abbastanza vicine alla propria. In questo passaggio c’è il confirmation bias.

A questo punto, introducono la quantità \(r^i_s\), la frazione di individui che hanno opinioni abbastanza vicine all’individuo \(i\). I ricercatori chiamano questi individui “supporter” di \(i\) nel senso che sono coloro che fanno aumentare la convinzione di \(i\) stesso nelle proprie idee. Ora, se questo valore supera una certa soglia \(\alpha\), individuata sperimentalmente, l’opinione di \(i\) evolve guardando solamente i propri vicini. Ecco, si è creata quella bolla sociale che alimenta i contenuti del nostro social e (apparentemente!) ci mostra un mondo che la pensa esclusivamente come noi. E a questo punto cominciamo a ignorare le opinioni diverse.

C’è anche un altro aspetto che emerge da questo lavoro. Infatti, se non si supera la soglia, ossia un individuo non vede contenuti a supporto della propria idea, scatta un altro fenomeno: la pressione sociale. Infatti, l’individuo tende a modificare la propria opinione guardando alla media dei propri vicini (forse anche dei vicini dei vicini). Questa caratteristica riflette svariati problemi che si vedono in rete e che riguardano soprattutto la fascia più giovane della popolazione.

Infine, l’articolo mostra che una piccola minoranza di individui più sensibili alla pressione sociale può ridurre fortemente la polarizzazione, soprattutto se occupa posizioni centrali nella rete, cioè nodi molto connessi. Oltre l’\(80%\) di questi utenti impressionabili tende alla fine a convergere verso posizioni moderate. Nasce così una fascia di moderati influenzabili, meno rumorosa degli estremi ma spesso decisiva negli equilibri collettivi.

In definitiva, il modello sviluppato descrive dinamiche che vediamo ogni giorno in rete. In particolare, oscilliamo tra la bolla sociale e il desiderio di una bolla sociale. E gli algoritmi dei social sembrano aver capito come soddisfare questo desiderio.