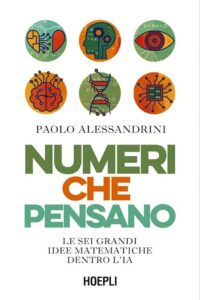

Numeri che pensano: le sei grandi idee matematiche dentro l’IA è un libro di Paolo Alessandrini edito da Hoepli, che vuole raccontare la matematica che sta alla base dell’intelligenza artificiale. Ce ne parla Alberto Saracco.

Paolo Alessandrini è un docente di matematica di scuola secondaria che si occupa da più di un decennio di divulgazione della matematica on-line (sul suo blog Mr. Palomar e su YouTube). Da vari anni si è dato anche alla scritture di libri divulgativi di matematica, con la casa editrice Hoepli. Questo è il suo quarto libro, dopo Matematica rock, Bestiario matematico e Matematica in campo.

Come recita il sottotitolo, Numeri che pensano vuole esplorare le grandi idee matematiche dentro l’intelligenza artificiale, facendo vedere come la matematica che ha permesso questa innovazione tecnologica sia varia e affondi le sue radici indietro nel tempo.

Il contenuto del libro

Il libro è diviso in dodici capitoli. Nei capitoli dispari, andando in ordine cronologico, si racconta la storia delle sei grandi idee matematiche di cui parla il sottotitolo, mentre nei capitoli pari, anch’essi in ordine cronologico, si analizza come queste idee siano state fondamentali per la storia dell’intelligenza artificiale.

Ogni capitolo dispari inizia con un breve racconto che ci fa immergere nell’atmosfera del capitolo stesso, raccontandoci in maniera romanzata un aspetto della vita del protagonista. Quasi sempre il racconto è di fantasia e racconta fatti verosimili o che avrebbero potuto essere così più che fatti reali, tranne nel capitolo su Cartesio, in cui viene fatto riferimento a tre sogni che sono stati descritti dal matematico-filosofo stesso.

Quali sono queste sei idee matematiche e le loro applicazioni? La prima è indubbiamente l’idea di probabilità:dietro tutti i metodi di apprendimento automatico c’è una profonda analisi dei dati, con uso di statistica e probabilità. La matematica del caso e dell’azzardo è nata in epoca relativamente recente, solo 5 secoli fa, quando nel Cinquecento Cardano si inizia a interessare al gioco della zara (in cui si lanciano 3 dadi a 6 facce e si cerca di indovinare la somma) e cerca di analizzarlo dal punto di vista matematico.

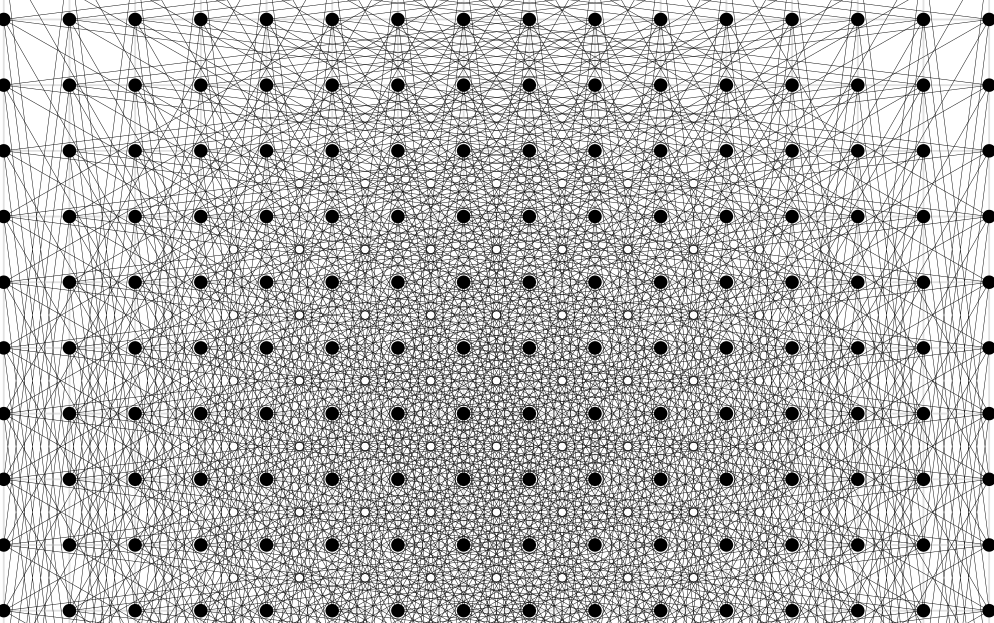

La seconda è un’idea che a noi sembra così ovvia che viene quasi da chiedersi come sia possibile che sia emersa in modo chiaro solo a inizio Seicento: l’idea del descrivere i punti del piano tramite una coppia di numeri reali, per poter descrivere oggetti geometrici nel piano tramite il linguaggio dell’algebra, la geometria analitica di Cartesio (e Fermat). La possibilità di descrivere oggetti geometrici prima e quasi qualunque cosa poi, tramite numeri, sta alla base non solo dell’intelligenza artificiale, ma di tutta l’informatica, oserei dire. Per i problemi di machine learning il vedere i dati come punti in un piano è fondamentale per i problemi di separazione e classificazione.

La terza grande idea si poggia sulla precedente ed è quella della nascita dell’analisi matematica, tramite il calcolo differenziale introdotto da Leibniz (e Newton) per studiare il cambiamento, i punti di massimo e di minimo delle funzioni e la velocità di variazione delle stesse. Questa idea si rivelerà fondamentale per cercare di minimizzare gli errori compiuti dall’IA e per migliorare il suo processo di apprendimento.

La probabilità, dicevamo, è al cuore dell’IA. Ma solo a metà del Settecento si può dire che nasca davvero, grazie alla formula di Bayes, che ci permette di fare vera probabilità e non semplice combinatoria dei “casi favorevoli su casi totali”: la formula di Bayes è fondamentale per riuscire a calcolare la probabilità che accada A sapendo che è accaduto B, cosa che ha un importanza fondamentale nell’analizzare le cause e gli effetti, come nell’interpretazione dei test medici di laboratorio (Marco Menale e Angelo Vulpiani ce ne hanno parlato qui). La formula di Bayes è -ad esempio- quella che permette a Netflix di consigliarci un film che ci piacerà o ad Amazon un articolo che vorremmo tanto acquistare.

A metà dell’Ottocento nasce poi l’idea di applicare la geometria analitica anche a spazi con più di 3 dimensioni: l’idea di Grassmann permette con pochissima fatica extra di trattare spazi di dimensione arbitraria e quindi di ottenere risultati enormemente più generali e applicabili in ambiti molto diversi tra loro. L’algebra lineare sarà uno degli strumenti fondamentali per l’IA, ma anche per moltissime altre applicazioni. Non è un caso che questa sia insegnata in ogni corso di ingegneria (e se siete curiosi di saperne di più, qui trovate un mio intero corso sull’argomento)!

L’ultima grande idea matematica è poi la generalizzazione della precedente, ovvero la matematica dei tensori introdotta da Gregorio Ricci-Curbastro e Tullio Levi-Civita. Tale matematica darà ad Einstein il linguaggio per esprimere la sua teoria della relatività generale e più tardi al machine learning un potentissimo strumento per l’apprendimento automatico.

Una lettura scorrevole

Per saperne di più, non posso che lasciarvi alla lettura del libro di Paolo Alessandrini. La scrittura è leggera e scorrevole e il formalismo matematico non è esagerato: è un libro pensato per essere letto dal curioso che vuole scoprire di più su questi affascinanti argomenti (e sulla matematica che c’è dietro) senza farlo perdere d’animo con i tecnicismi. Ciò nonostante, il libro cerca di mantenere un buon grado di rigore: è una bella lettura consigliatissima a tutti i curiosi, a partire dagli studenti delle scuole superiori. La lettura procederà veloce e Paolo Alessandrini vi guiderà in un affascinante viaggio di scoperta dell’Intelligenza Artificiale e della matematica su cui si basa.

Paolo Alessandrini

Numeri che pensano. Le sei grandi idee matematiche dentro l’IA

Hoepli, 212 pp., 18,90 euro

Compralo su Amazon.

Compralo su Hoepli.