Giulio Sandini è Direttore di Ricerca presso l’Istituto Italiano di Tecnologia (IIT) – dove ha fondato il dipartimento di Robotics, Brain and Cognitive Sciences – e professore ordinario di Bioingegneria all’Università di Genova. Ha coordinato diversi progetti internazionali nelle aree della visione artificiale, delle scienze cognitive e della robotica e in particolare lo sviluppo della piattaforma umanoide iCub. Lo intervista per noi Massimo Ferri.

Massimo – Giulio, come è nato il progetto iCub? A proposito, come si pronuncia? “Àicab”?

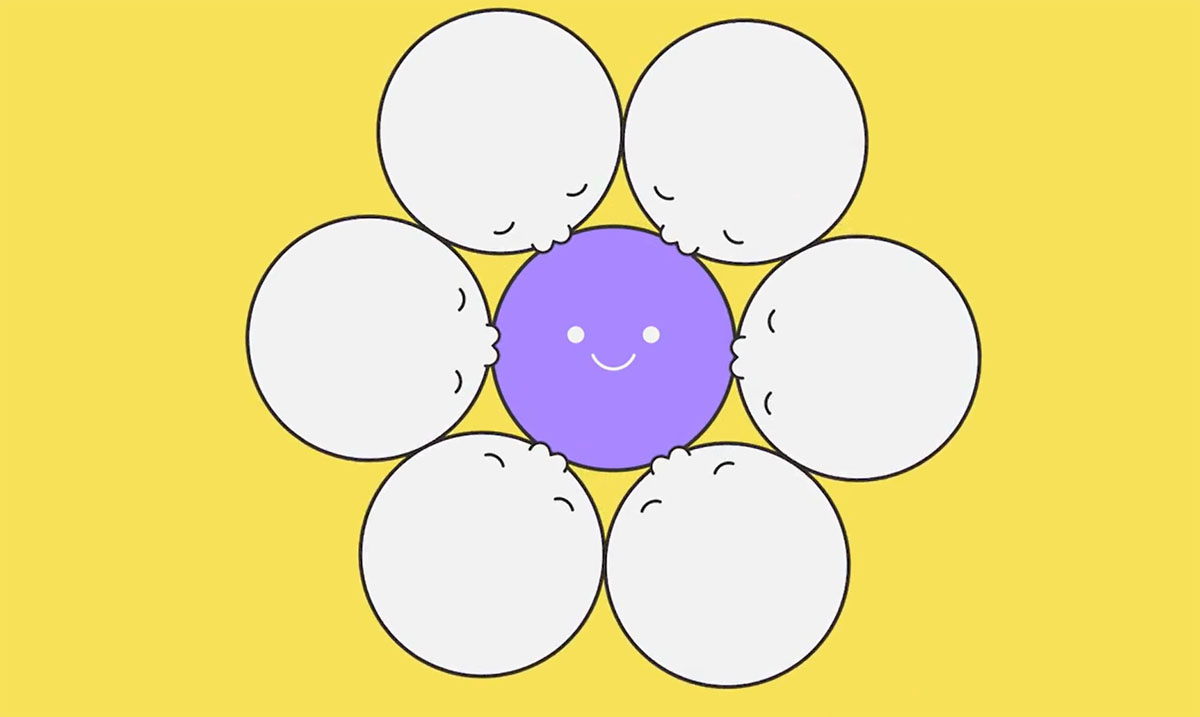

Giulio – Sì, la pronuncia è quella; “cub” è inteso come cucciolo; dietro a questa parola c’è tutto un filone di ricerca, quello della robotica dello sviluppo. L’origine è un progetto europeo che si chiamava RobotCub, nome ispirato al Man-cub , il cucciolo di uomo di Kipling. L’idea è di studiare lo sviluppo dell’essere umano attraverso la realizzazione di un “cucciolo di robot” che impara.

M – Ci siamo conosciuti quando le nostre barbe erano nere, nell’ambito della computer vision. Ora sei un pioniere della robotica antropomorfa. Puoi descrivermi il tuo percorso scientifico?

G – L’imprinting l’ho avuto al terzo anno di Ingegneria, quando ho incontrato Vincenzo Tagliasco. Lui, Piero Morasso ed altri stavano fondando un gruppo di bioingegneria. Mi inserii nello studio del coordinamento occhi-testa. Era uno dei primi esempi di modello matematico di un sistema biologico, sulla scorta degli studi di cibernetica di Wiener e, in Italia, di Caianiello. Era la prima volta che si facevano esperimenti sull’umano, misurando movimenti degli occhi e della testa e sviluppandone modelli in teoria del controllo. Di lì si è prodotta una catena di eventi. C’era il Progetto Finalizzato Tecnologie Biomediche del CNR; in quell’ambito c’era una collaborazione fra il gruppo di Genova e quello di neuroscienze di Lamberto Maffei a Pisa. Dopo la laurea in Ingegneria Elettronica entrai come perfezionando alla Normale per lavorare con Maffei. Per diversi anni trattai gli aspetti ingegneristici degli esperimenti e dalla modellazione delle risposte dei neuroni della corteccia visiva. Lì mi nacque l’interesse sulla modellazione della visione in senso lato.

M – Però si trattava ancora della visione umana?

G – Sì, c’erano diverse domande di fondo. Perché la retina dell’uomo è fatta in questo modo, spaziovariante, con una fovea ad alta risoluzione? Come avviene la trasmissione dalla retina alla corteccia? Ebbi una parentesi di un anno e mezzo al Children’s Hospital a Boston, in cui misi in piedi una tecnica di mappatura di dati elettroencefalografici in uno studio sui bimbi dislessici. Tornato a Genova e proseguendo gli studi sulla struttura spaziovariante della retina cominciai ad occuparmi più specificamente di computer vision; era il periodo della “visione attiva” di Dana Ballard e Ruzena Bajcsy; l’idea partiva dall’osservazione che l’osservatore visivo non è passivo, ma può controllare il suo movimento (cambiando il suo punto di vista) in funzione del compito visivo. In effetti, soprattutto avendo una retina spaziovariante hai bisogno di muoverla, la fovea in funzione del punto di interesse (la visione attiva appunto)! Sono passato da questi studi all’idea di realizzare una testa servocontrollata con due telecamere (visione stereoscopica) a bordo. Dal semplice movimento degli occhi passi poi in modo naturale all’osservatore che agisce nel mondo: alla testa si aggiunge il braccio. Poi l’interesse si orienta verso un sistema che da un lato rispecchi quello che si sa del sistema uomo, dall’altro ti permetta verifiche delle teorie che formuli sul funzionamento del sistema nervoso. A quel punto fai presto ad arrivare all’umanoide come palestra ideale dove sperimentare i modelli dell’umano. Dallo studio della retina si è passati a tematiche più generali, parallelamente a quanto avveniva nelle neuroscienze, dove inizialmente le ricerche erano molto parcellizzate: chi studiava gli aspetti visivi, chi quelli acustici eccetera. L’orizzonte si è allargato agli aspetti cognitivi, integrando fra loro i diversi sistemi.

M – Molto interessante. Dunque l’IIT ti ha dato la possibilità di realizzare questo progetto.

G – In realtà iCub è un progetto partito quando lavoravo all’università; coordinavo undici laboratori in Europa, con un finanziamento cospicuo. L’obiettivo era di realizzare un umanoide da utilizzare come strumento di ricerca sullo sviluppo delle capacità percettive, motorie e cognitive dell’umano; nel gruppo c’erano anche Luciano Fadiga, un neuroscienziato, e Claes von Hofsten, che si occupa di sviluppo cognitivo. La proposta era di realizzare un sistema open source: costruire un umanoide in modo che gli studiosi interessati alla cognizione avessero uno strumento da condividere. Dal punto di vista della ricerca iCub è uno degli umanoidi più utilizzati. In quel periodo è nata l’idea dell’IIT; insieme a Maffei e a Fabio Beltram della Normale abbiamo dato una mano a Roberto Cingolani a stendere il primo piano scientifico dell’IIT, cioè di un ente multidisciplinare inizialmente con tre linee di ricerca: robotica, neuroscienze e nanotecnologie (allora avevamo definito il tema come “tecnologie umanoidi”). L’IIT si è preso carico della continuazione del progetto RobotCub che stava terminando e che altrimenti non sarebbe mai arrivato al livello di adesso e iCub è diventato l’esempio più rappresentativo della convergenza scientifica ricercata in IIT.

M – Hai già in gran parte risposto alla mia prossima domanda: come rispondi alle critiche mosse alla robotica antropomorfa, secondo cui sarebbe interessante soprattutto per la sua attrattività mediatica? La risposta mi sembra chiara per iCub, tuttavia mi sembra fondata per altri sistemi.

G – Credo che tu ti riferisca agli androidi di Hiroshi Ishiguro molto realistici, con la pelle in silicone eccetera. È vero che l’umanoide ha un’attrattività mediatica, ma perché il nostro cervello è attratto dall’umano. Calvino in una delle sue Lezioni aveva detto che la nostra immaginazione non può essere che antropomorfa: in effetti, qualsiasi cosa noi guardiamo, inconsapevolmente tendiamo a interpretarla in termini della forma del corpo umano, del comportamento umano. La rappresentazione dell’umano è nel nostro cervello e questa rappresentazione non consente (o forse ci costringe) a immedesimarci negli altri: i neonati sanno individuare un volto (indipendentemente dal colore della pelle) e il suono della voce umana! Un umanoide produce uno stimolo emotivo maggiore che altre forme di robot. Ma è proprio questo che noi studiamo e per questo motivo ci serve un umanoide per studiare cosa ci rende umani. D’altra parte le realizzazioni, per esempio, della Hanson Robotics, con un viso di donna molto realistico, anche se sono interessanti dal punto di vista tecnologico rimangono marionette i cui fili sono rappresentati dalle linee di codice dei programmi che li controllano. L’intelligenza che ci sembra di vedere nei loro movimenti è solo nella mente di chi osserva perché la reazione di un umano davanti a un viso che ti sorride è di pensare, implicitamente, che dietro ci sia un cervello come il nostro; ma questa somiglianza solo esteriore (il robot si muove ma non capisce), non inganna il nostro cervello, che percepisce quel comportamento da zombie e prova un senso di inquietudine.

M – Penso che le reazioni ad iCub siano molto più serene.

G – Certo! È un oggetto chiaramente artificiale, inoltre è alto come un bambino e cerchiamo di capire come renderne il comportamento più “umano” cercando di insegnargli non solo come muoversi ma anche come interpretare le azioni di noi umani, le nostre intenzioni. Se iCub fosse alto due metri e si comportasse da Zombie la reazione sarebbe diversa.

M – Perdonami la prossima domanda, molto generica. Ogni tanto ci sono personalità influenti (penso a Stephen Hawking) che esprimono timori sul futuro della robotica e dell’intelligenza artificiale. Cosa rispondi a chi teme che stiate preparando, magari inconsapevolmente, Terminator?

G – È una domanda che mi viene rivolta spesso, ma questo è comprensibile. Credo che i timori, associati ai possibili sviluppi dell’intelligenza artificiale e dintorni, siano dovuti al fatto che i meccanismi alla base dell’intelligenza sono ancora largamente ignoti. Non sappiamo ancora cosa sia l’intelligenza, com’è implementata nei sistemi biologici; c’è quindi il timore che essendo una cosa misteriosa possa svilupparsi in modo incontrollato. Certo gli studi che facciamo possono essere applicati in modo negativo (ed è per questo che se ne deve parlare esplicitamente) ma lo stesso si può dire di tutta la tecnologia.

M – Veramente non credo che il pubblico sia tanto preoccupato di un cattivo uso dell’intelligenza artificiale, quanto del fatto che essa possa sfuggire al controllo umano.

G – Questo timore, che nasce dagli aspetti ancora sconosciuti dell’intelligenza, viene accentuato dall’impressione, a mio avviso sbagliata, che gli obiettivi dell’intelligenza artificiale (intesa nel senso della capacità di realizzare sistemi dotati di intelligenza “umana”) siano vicini. Bisognerebbe riuscire a far comprendere quali sono le distanze reali, riuscire a dare la percezione del percorso ancora da compiere. Va benissimo parlarne, però in un contesto in cui sia ben chiaro quello che sappiamo, quello che stiamo sperimentando e quello che è ancora sconosciuto. Invece ho visitato da poco il Museo Mori di Tokyo, dove c’era un’esposizione su intelligenza artificiale, robotica, il mondo del futuro; c’erano belle installazioni, ma era un guazzabuglio fra quello che c’è, quello che potrà esserci e quello che forse non ci sarà mai, tutto mescolato. Questi sono messaggi sbagliati nel loro essere parziali e ambigui.

M – Veniamo a un punto caro a me e ai frequentatori di MaddMaths!: quanta e quale matematica entra nelle vostre ricerche? In particolare, ci sono problemi per cui sentireste il bisogno di nuova matematica ad hoc?

G – Tutti gli aspetti di controllo, di elaborazione di segnali richiedono strumenti matematici consolidati. Quello che sarebbe auspicabile penso possa essere una visione di più ampio respiro. Così come dicevo prima della ricerca parcellizzata in visione, acustica, controllo motorio, lo stesso potrebbe valere per l’apporto matematico: ci sono tanti strumenti, usati singolarmente. Potrebbe esserci una matematica di integrazione per cercare di arrivare a studiare i principi alla base dei modelli che costruiamo che hanno in genere una valenza descrittiva; pochi arrivano invece a una valenza esplicativa. Occorrerebbe una tipologia di modello più avanzata. L’esempio che faccio sempre è quello del volo: Leonardo costruiva macchine simulando le ali degli uccelli, costruendo un modello descrittivo del volo. Ma, se pure i modelli descrittivi sono un passo necessario, modelli esplicativi consentono di capire i princìpi dell’aerodinamica e di realizzare oggetti che volano, fatti in modo totalmente diverso. Quando la complessità dei sistemi diventa molto elevata I modelli matematici dimostrano i loro limiti, tant’è vero che esistono ancora le gallerie del vento; anche per l’intelligenza credo che occorra integrare la descrizione analitica con la parte sperimentale, che è poi la ragione per cui noi usiamo un robot fisico invece di un avatar al calcolatore. Fra l’altro, per quanto riguarda la robotica, noi usiamo iCub non solo come modello del sistema umano, ma anche come stimolo negli studi sull’interazione sociale. Per esempio, in quello che facciamo noi, occorrerebbero modelli per il ruolo delle emozioni nelle interazioni uomo-uomo e uomo-robot.

M – Mi ricordo un libro di Rosalind Picard in proposito: Affective computing. Però non c’erano modelli formali.

G – Queste sono cose su cui cominciamo a trovare qualche regolarità forse modellabile analiticamente. Stiamo raccogliendo dati e formulando teorie non solo su come le emozioni vengono espresse, ma anche su come vengono trasmesse, si scambiano, evolvono nel tempo. Non abbiamo ancora un modo di descrivere analiticamente queste cose; invece potrebbe, dovrebbe esserci. È un po’ la carenza che c’è nella descrizione del movimento: non c’è ancora nessun metodo che riesca a descrivere efficacemente un passo di danza se non il passo stesso! Tornando alla matematica, occorrerebbe più dialogo: forse sono disponibili strumenti che risparmierebbero a noi del tempo e ci sono situazioni che possono suggerire a voi degli sviluppi teorici. Un grave ostacolo sono le barriere accademiche che tuttora esistono. Magari poi la soluzione non c’è , ma occorre almeno provarci.

M – Già che ci siamo, all’IIT assumete matematici? Se sì, in che mansioni? Quali competenze devono avere?

G – Matematici ce ne sono. Ciò che caratterizza l’IIT è l’interdisciplinarità; gli ingegneri sono solo un terzo dei membri, gli altri sono biologi, fisici matematici, filosofi. Sono selezionati sulla base dell’interesse scientifico e degli strumenti che hanno a disposizione e non della laurea. Il matematico si può trovare a sviluppare un algoritmo di controllo o di elaborazione di segnali o di analisi di dati biologici; è impiegato in statistica, in machine learning. Non abbiamo, invece, matematici, come dire, “teorici”; per quanto dicevo, sarebbe certamente interessante poterli avere nei gruppi di ricerca, ma occorrerebbe un loro interesse verso le tematiche che vengono sviluppate qui.

Intervista a cura di Massimo Ferri